Anatomía de un Agente de IA

By:César Medina

Contact: cesar.medina@innovox.com.br

- Lectura en 5 minutos - 1054 palabrasArtículo 3 de la Serie de IA con Agentes: Sistemas que Perciben, Deciden y Actúan

< Artículo anterior | Seguiente Artículo >

La mayoría de los problemas de producción con agentes de IA se atribuyen a los límites del modelo. En la práctica, el problema suele ser arquitectónico. El bucle está mal diseñado, poco restringido o no se ejecuta de forma fiable.

Si quieres agentes que realmente funcionen en producción, necesitas entender cómo están estructurados antes de escribir cualquier código.

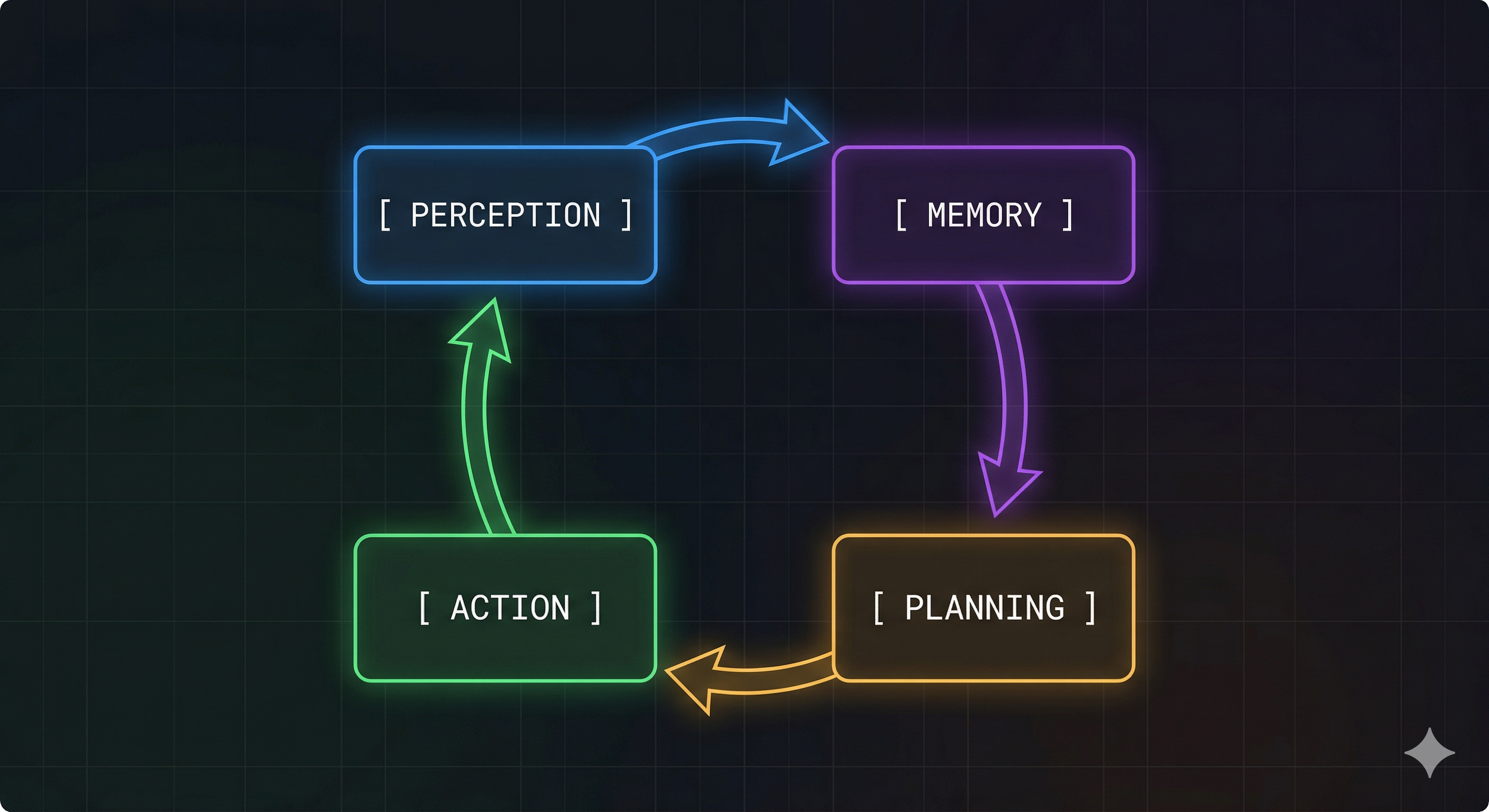

Los 4 Pilares Fundamentales

Cada agente de IA, sin importar el framework o modelo, se basa en cuatro componentes principales. Una vez que los entiendes, resulta mucho más fácil tomar decisiones de diseño sólidas y depurar problemas cuando las cosas fallan.

1. Percepción

La percepción es cómo el agente se conecta con el mundo exterior. A menudo se describe como “entrada” (input), pero eso no capta la esencia. Es, en realidad, una interfaz con expectativas claras.

Los sistemas robustos nunca pasan datos brutos directamente al razonamiento. Dependen de entradas estructuradas, validadas y filtradas. Eso significa que debes pensar cuidadosamente en:

- Cómo se estructura la entrada para que sea consistente.

- Cómo se gestionan las ambigüedades y los problemas de formato desde el principio.

- Qué información merece la pena conservar y cuál debe ignorarse.

La percepción puede provenir de texto, APIs, eventos, archivos o bases de datos. Lo que más importa es el formato, las garantías que lo respaldan y su fiabilidad.

Si la percepción es caótica, todo lo que sigue también lo será. El modelo no puede arreglar una entrada que nunca comprendió correctamente.

2. Memoria

La memoria suele pasarse por alto, y es donde muchos sistemas se desmoronan.

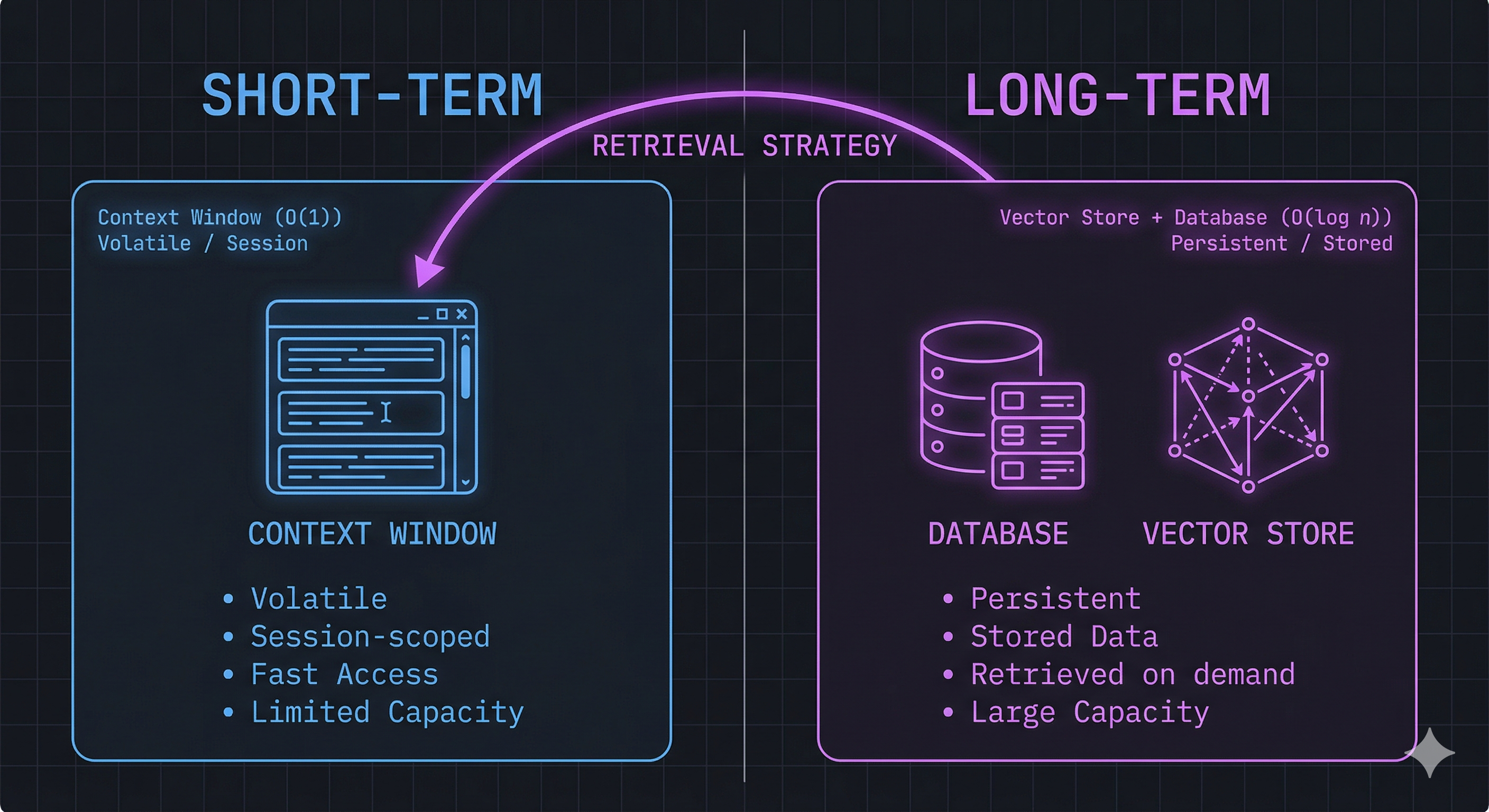

Existen dos tipos principales:

La memoria a corto plazo reside dentro de la ventana de contexto. Es rápida y fácil de usar, pero limitada y temporal.

La memoria a largo plazo se almacena fuera del modelo, en bases de datos o almacenes de vectores (vector stores), y se extrae cuando es necesario.

Un error común es tratar la ventana de contexto como memoria real. No lo es. Es solo un área de trabajo.

El verdadero reto es la recuperación (retrieval). Guardarlo todo es fácil. Obtener la información adecuada en el momento preciso, no. Una mala recuperación genera un contexto saturado, mayores costes y un razonamiento deficiente.

Necesitas definir:

- Cómo se recupera la información.

- Qué se recupera frente a qué se queda almacenado.

- Cómo equilibrar velocidad y relevancia.

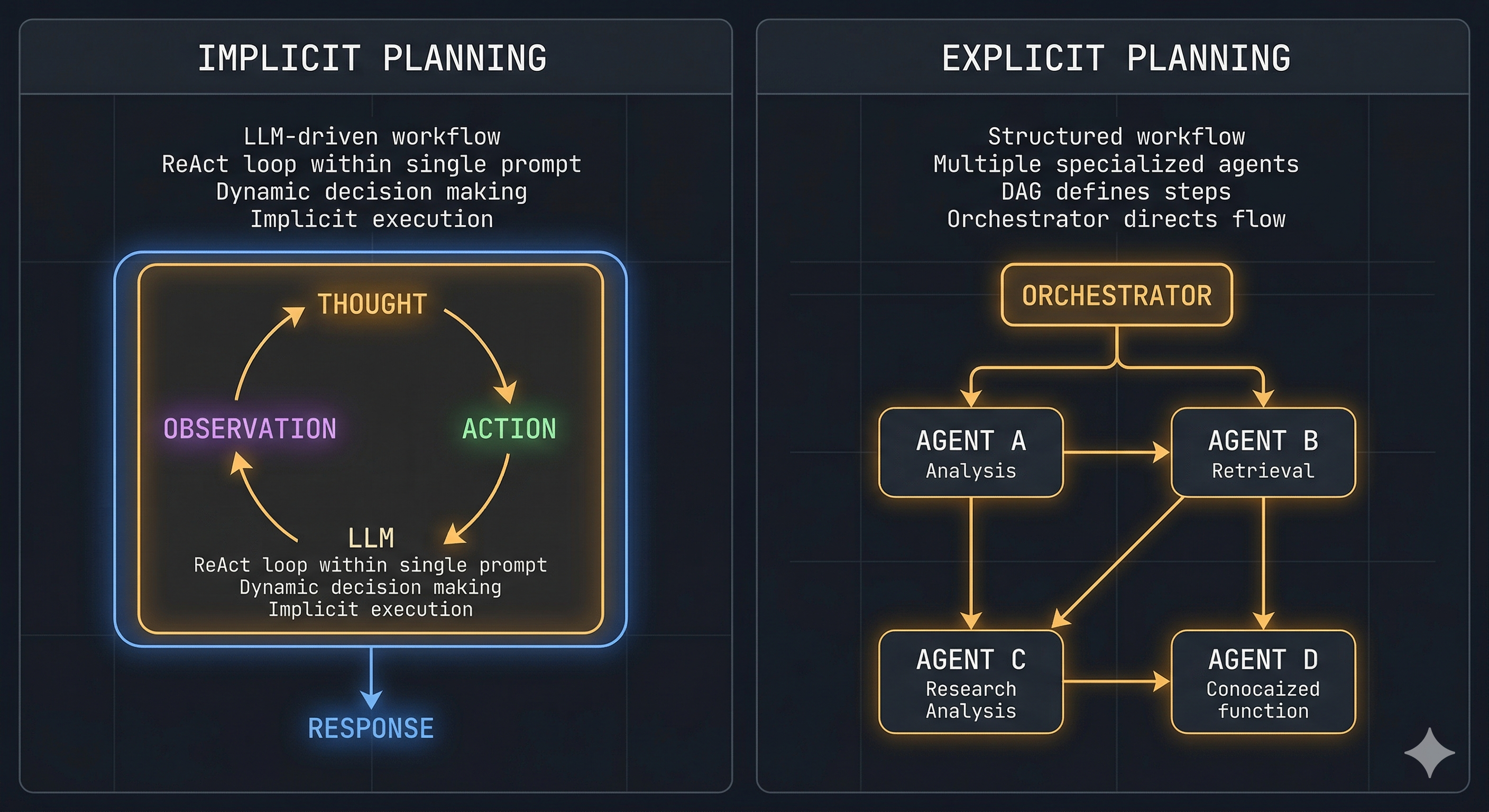

3. Planificación

La planificación es donde el sistema decide qué hacer a continuación. Se sitúa entre la comprensión y la acción.

Esto suele ocurrir de dos maneras:

La planificación implícita ocurre dentro del modelo. El LLM decide el siguiente paso basándose en el prompt. Es flexible y sencillo de configurar, pero difícil de controlar y aún más difícil de depurar.

La planificación explícita reside en el diseño del sistema. El flujo está claramente definido mediante estructuras como grafos de tareas, máquinas de estado o múltiples agentes trabajando juntos.

Los sistemas que solo confían en la planificación implícita suelen funcionar en demos, pero sufren en entornos reales. La planificación explícita añade estructura, hace que el comportamiento sea más observable y te otorga más control.

Ese cambio, de lo implícito a lo explícito, es a menudo lo que separa algo que funciona una vez de algo que funciona consistentemente.

4. Acción (Herramientas)

Las herramientas son las que permiten al agente realizar un trabajo real. Pueden ser APIs, consultas a bases de datos, ejecución de código, navegación web u operaciones con archivos.

Más herramientas aumentan la capacidad del agente, pero también introducen más riesgos. Cada llamada a una herramienta puede fallar.

A diferencia de la generación de texto, el uso de herramientas tiene consecuencias. Una mala llamada puede corromper datos, activar acciones no deseadas o bloquear el progreso.

Por ello, el uso de herramientas necesita protecciones (guardrails):

- Validar las entradas antes de la ejecución.

- Gestionar fallos y reintentos correctamente.

- Definir comportamientos de respaldo (fallback).

- Añadir supervisión humana cuando hay mucho en juego.

Aquí es donde el agente interactúa con el mundo real, por lo que requiere el máximo cuidado.

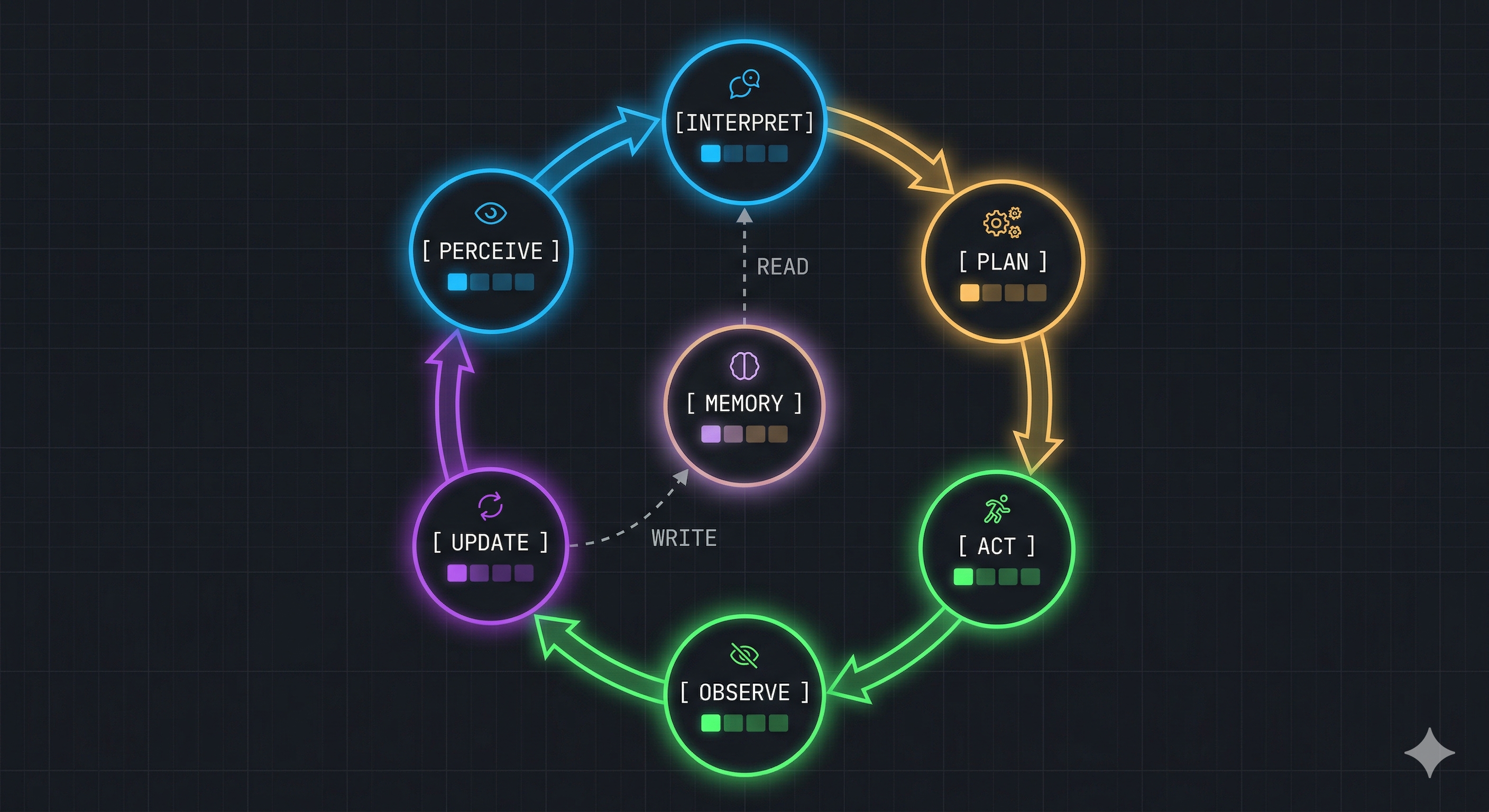

El Flujo Completo: Un Sistema de Bucle Cerrado

Los agentes no operan en línea recta. Funcionan en un bucle donde cada acción afecta a lo que sucede después.

Percibir → Interpretar → Planificar → Actuar → Observar → Actualizar → Repetir

El paso de actualización es más importante de lo que parece. Es donde se escribe la memoria antes del siguiente ciclo. Sin él, el agente se comporta como si olvidara todo entre pasos.

Este bucle continúa hasta que se completa la tarea, se alcanza una condición de parada o el sistema falla.

El control no proviene solo del modelo. Proviene de cómo interactúan el modelo, la memoria, las herramientas y el entorno a lo largo del tiempo.

A menudo se le llama bucle ReAct, pero en la práctica se generaliza a una clase más amplia de bucles de control agéntico. El flujo de control resulta de la interacción entre el modelo y el resto de los componentes.

Modos de Fallo

Cada parte del sistema tiende a fallar a su manera:

- Los problemas de percepción conducen a un razonamiento seguro pero incorrecto.

- Los problemas de memoria causan repetición o pérdida de contexto.

- Una planificación débil resulta en bucles infinitos o tareas bloqueadas.

- El mal manejo de herramientas provoca errores en el mundo real.

La mayoría de los fallos se remontan a una de estas áreas, aunque se culpe al modelo. El modelo es solo una parte del sistema.

Conclusión

Los agentes no son sistemas lineales. Son cíclicos.

Si los diseñas como simples flujos de trabajo (pipelines), se romperán cuando el entorno se vuelva impredecible. Los sistemas que pueden observar resultados, ajustar e intentar de nuevo son los que resisten.

Cada ciclo mejora la comprensión del agente al sustituir las conjeturas por retroalimentación real.

Eso es lo que diferencia a los sistemas basados en agentes del software tradicional. El comportamiento no está totalmente predefinido. Emerge de la interacción.

Este es el tercer artículo de una serie sobre IA con agentes: sistemas que perciben, deciden y actúan. Es lo suficientemente técnico para desarrolladores, pero accesible para quienes se inician en este campo.

< Artículo anterior | Seguiente Artículo >

Equipo de ingeniería de InnoVox

Ingenieros especializados en la creación de sistemas de IA confiables